Stärke das Vertrauen in deine KI mit Methoden für Modellinterpretation und erklärbare Vorhersagen.

Steckbrief

- ECTS-Punkte

- 2 / 2

- Nächster Start

- 4.12.2026

- Dauer

- 2 Unterrichtstage

- Durchführungssprache

- Deutsch

- Durchführungsort

- FHNW Campus Brugg-Windisch

- Preis

- CHF 1200.–

- Dokumente

Ziele und Nutzen

Um immer bessere Ergebnisse bei der Arbeit mit Machine Learning zu erreichen liegt der Fokus auf der Auswahl des leistungsfähigsten Modells. Hierfür nutzt man Werte wie Accuracy oder RSME, die man optimieren will. Sie zeigen an, wie oft das Modell richtig liegt, beziehungsweise wie weit das Modell danebenliegt.

Mit einem starken Fokus auf diese Werte wird häufig einer Frage weniger Beachtung geschenkt: Welche Schlüsselfaktoren verwendet der Algorithmus schlussendlich tatsächlich, um den optimalen Wert zu erreichen? Die Identifikation dieser Schlüsselfaktoren ist entscheidend, um die Modelle nicht nur leistungsfähig, sondern auch nachvollziehbar und vertrauenswürdig zu gestalten.

Sie zu bestimmten wird komplexer, je umfangreicher die Modellen werden. Neuronale Netze oder Ensembles basieren auf gewichteten Faktoren, die nicht einfach anhand ihrer Parameter abgelesen werden können.

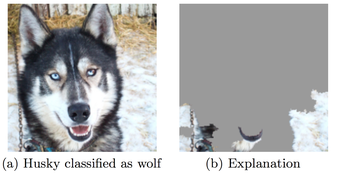

Nachfolgendes Beispiel aus der Publikation „‘Why should I trust you?‘ Explaining the Predictions of Any Classifier“ zeigt beim Klassifikationsproblem „Wolf oder Husky“, welche Pixels den Algorithmus bei seiner (Fehl-)Entscheidung am meisten beeinflusst haben: Der Schnee im Hintergrund und nicht das Tier selbst.

Mit Hilfe von Explainable AI gelingt so ein wervoller Blick hinter die Kulisse von Künstlicher Intelligenz. Das Beispiel zeigt uns, dass die Trainingsdaten offenbar zu einseitig waren. Fügt man den Trainingsdaten weitere Bilder von Huskys im Schnee hinzu, ist dieser nicht mehr alleinig für die Klassifizierung möglich. Der Algorithmus muss für die korrekte Klassifizierung andere Faktoren stärker gewichten, um somit besser zu generalisieren.

Werden die Entscheidungen eines so wichtiges Tool wie AI nachvollziehbarer, schafft diese Transparenz auch Vertrauen bei Vorgesetzten und Kunden. Verständliche Entscheidungsprozesse bei der Anwendung von Machine Learning sind in verschiedenen Bereichen wie beispielsweise der Medizin oder Strafrecht fundamental.

Bildgestütze Tumorerkennung oder auf Diskriminierung sensibilisierte Algorythmen sind nur zwei Beispiele hierfür.

Lernziele

Du weisst:

- wie «Interpretierbarkeit» im Kontext von ML zu verstehen ist.welche simpleren Modelle interpretierbar sind und wie du diese interpretieren kannst.

Du kennst :

- verschiedene Modell-unabhängige Ansätze («Model agnostic methods» oder «Example based explanations») und kannst diese anwenden, um neben den simplen Modellen auch komplexere wie Ensembles oder Neuronale Netze zu interpretieren.

- neben bewährten Techniken auch die neusten Entwicklungen im Bereich «Explainable AI».

Inhalt und Aufbau

In diesem Kurs lernst du, wie einfache Machine-Learnng-Modelle interpretiert werden können. Du erfährst zudem, mit welchen Techniken sich die Entscheidungsgrundlagen Modelle nachvollziehen lassen. Diese Techniken lassen sich auf simple und komplexere Modelle, wie Ensembles oder Deep Learning, anwenden.

Technologien: Python

Voraussetzungen und Zulassung

Für diesen Kurs brauchst du Grundkenntnisse in linearer Algebra, Wahrscheinlichkeitsrechnung und Machine Learning. Du musst in der Lage sein, Machine Learning mit Python durchzuführen und die gängigen Libraries wie numpy oder sklearn kennen.

Organisatorisches

Abschluss

Kursvorbereitung

Mindestteilnehmerzahl

Unterrichtstage

Tritt mit uns in Kontakt

Info-Anlässe

Loading...